Ha aspettato di andarsene da Google per parlare. Geoffrey Hinton, pluripremiato pioniere dell’intelligenza artificiale, mette in guardia dai pericoli che questi algoritmi possono rappresentare per l’uomo.

Ha paura che stiamo rilasciando qualcosa di pericoloso in natura. IA generativa può già essere uno strumento di disinformazione. Presto, potrebbe essere un rischio per i posti di lavoro. Da qualche parte lungo la linea, dicono i più grandi preoccupati della tecnologia, potrebbe essere un rischio per l’umanità.

I leader del settore credono che la nuova A.I. potrebbero essere importanti quanto l’introduzione del browser Web all’inizio degli anni ’90 e potrebbero portare a scoperte in aree che vanno dalla ricerca sui farmaci all’istruzione, ma ci sono dei rischi.

In una recente intervista al New York Time, ne parla diffusamente. “È difficile vedere come puoi impedire ai cattivi attori di usarlo per cose cattive”, ha detto il dottor Hinton.

Il capo scienziato di Google, Jeff Dean, ha dichiarato: “Rimaniamo impegnati in un approccio responsabile all’A.I. Impariamo continuamente a comprendere i rischi emergenti e allo stesso tempo innoviamo con coraggio”.

Man mano che le aziende migliorano la loro I.A. sistemi, secondo lui, diventano sempre più pericolosi. “Guarda com’era cinque anni fa e com’è adesso”, ha detto di A.I. tecnologia. “Prendi la differenza e propagala in avanti. È spaventoso.”

I giganti della tecnologia sono bloccati in una competizione che potrebbe essere impossibile fermare, ha affermato il dottor Hinton.

La sua preoccupazione immediata è che Internet sarà inondato di foto, video e testi falsi e la persona media “non sarà più in grado di sapere cosa è vero”.

È anche preoccupato che A.I. le tecnologie col tempo sconvolgeranno il mercato del lavoro. Oggi, chatbot come ChatGPT tendono a integrare i lavoratori umani, ma potrebbero sostituire paralegali, assistenti personali, traduttori e altri che gestiscono compiti meccanici. “Toglie il lavoro faticoso”, ha detto. “Potrebbe portare via più di questo.”

Lungo la strada, è preoccupato che le versioni future della tecnologia rappresentino una minaccia per l’umanità perché spesso apprendono comportamenti inaspettati dalle enormi quantità di dati che analizzano. Questo diventa un problema, ha affermato, poiché gli individui e le aziende consentono ad A.I. sistemi non solo per generare il proprio codice informatico, ma anche per eseguirlo da soli. E teme un giorno in cui armi veramente autonome – quei robot assassini – diventeranno realtà.

“L’idea che questa roba potesse effettivamente diventare più intelligente delle persone – alcune persone ci credevano”, ha detto. “Ma la maggior parte delle persone pensava che fosse lontano. E ho pensato che fosse lontano. Pensavo che mancassero dai 30 ai 50 anni o anche di più. Ovviamente non lo penso più”.

A differenza delle armi nucleari, ha detto, non c’è modo di sapere se aziende o paesi stanno lavorando in segreto sulla tecnologia. La migliore speranza è che i principali scienziati del mondo collaborino su modi per controllare la tecnologia. “Non credo che dovrebbero aumentare ulteriormente la situazione fino a quando non avranno capito se possono controllarla”

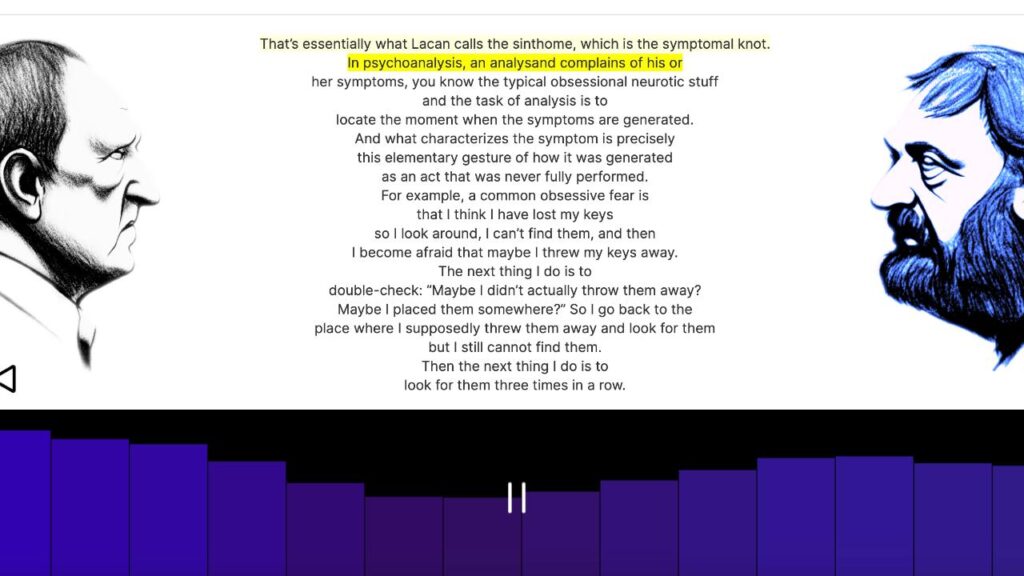

Il Dr. Hinton, un espatriato britannico di 75 anni, è un accademico per tutta la vita la cui carriera è stata guidata dalle sue convinzioni personali sullo sviluppo e l’uso dell’IA. Nel 1972, come studente laureato presso l’Università di Edimburgo, il Dr. Hinton abbracciò un’idea chiamata rete neurale. Una rete neurale è un sistema matematico che apprende abilità analizzando i dati. A quel tempo, pochi ricercatori credevano nell’idea. Ma è diventato il lavoro della sua vita.

Negli anni ’80, il dottor Hinton era un professore di informatica alla Carnegie Mellon University, ma lasciò l’università per il Canada perché disse di essere riluttante ad accettare finanziamenti dal Pentagono. A quel tempo, la maggior parte di A.I. la ricerca negli Stati Uniti è stata finanziata dal Dipartimento della Difesa. Il dottor Hinton è profondamente contrario all’uso dell’intelligenza artificiale sul campo di battaglia, quelli che chiama “soldati robot”.

Nel 2012, il dottor Hinton e due dei suoi studenti a Toronto, Ilya Sutskever e Alex Krishevsky, hanno costruito una rete neurale in grado di analizzare migliaia di foto e imparare a identificare oggetti comuni, come fiori, cani e automobili.

Qui l’intervista completa: https://www.nytimes.com/2023/05/01/technology/ai-google-chatbot-engineer-quits-hinton.html

Le opinioni espresse in questo articolo sono dell’autore.

Leggi le ultime news su: https://w3b.today

Può interessarti anche: AI: “È necessaria una regolamentazione rigorosa per evitare effetti dannosi”, il Ceo di Google

Seguici su Telegram https://t.me/presskit

Seguici su Facebook https://www.facebook.com/presskit.it